淘工位首页/行业资讯/算力即主权:NVIDIA如何通过系统工程重构AI时代的经济底层逻辑/ 算力即主权:NVIDIA如何通过系统工程重构AI时代的经济底层逻辑

2026-03-30 00:00:00

文章转载自"北大纵横"

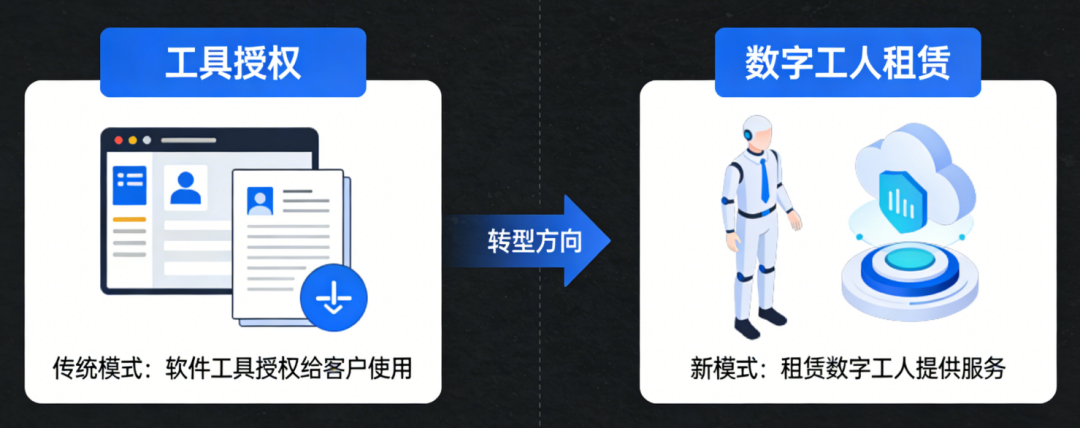

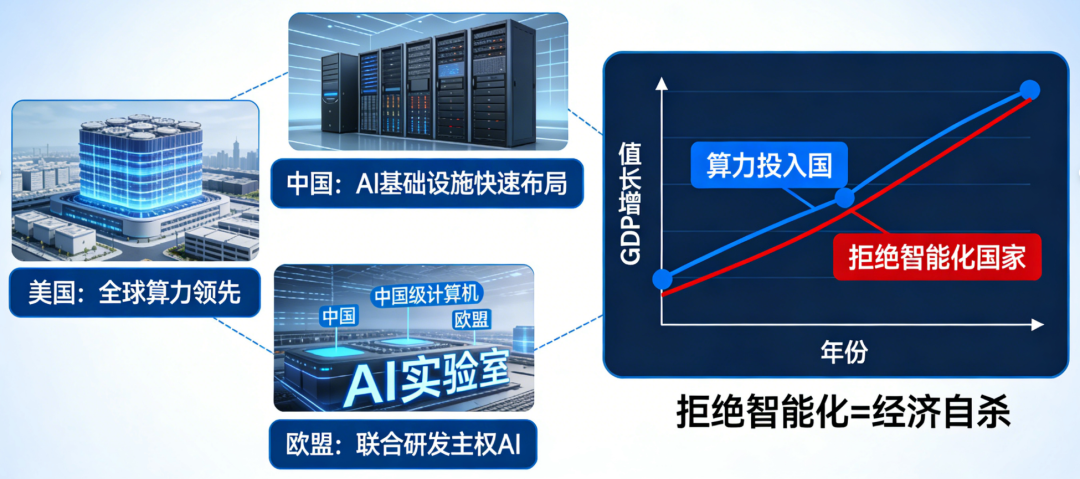

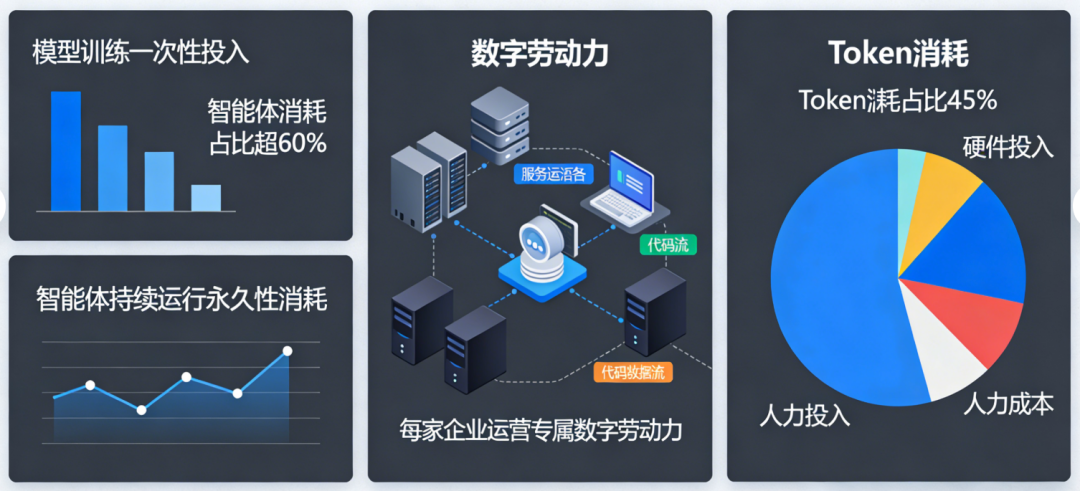

从1998年IPO时年营收仅4800万美元,到2026年单季净利润达460亿美元,NVIDIA的增长曲线远非“GPU需求爆发”所能解释。这不仅重塑了AI产业的分工格局,更正在重新书写企业价值与国家竞争力的底层公式。今天这篇文章,咱们一起穿透“芯片神话”的表象,解析NVIDIA如何通过“全栈架构—计算经济学—范式跃迁—生态战略—物理智能”五重机制,构建起难以复制的系统性护城河。市场普遍将NVIDIA简化为“AI芯片龙头”,这种认知偏差源于对技术演进路径的线性理解,忽视了计算范式变革中“系统协同效率”对单一硬件性能的碾压性优势。 回溯历史,NVIDIA的基因并非来自半导体制造,而是计算机图形学中的算法优化。在CPU主导的1990年代,99%的计算时间消耗在5%的核心循环代码上。早在1993年成立之初,公司就部署DevTech工程师深入Epic Games等游戏引擎开发商内部,将GeForce驱动直接集成至Unreal Engine底层。这种“前向集成”策略,使GeForce成为游戏开发的事实标准,并意外培育出一代AI先驱——Ilya Sutskever等人正是通过GTX 580与CUDA,首次验证了通用并行计算在深度学习中的可行性。 NVIDIA的竞争壁垒不在晶体管密度,而在纵向集成的系统迭代速度。从指令集(PTX)、微架构(Hopper/Blackwell)、芯片设计(Grace Hopper Superchip),到软件栈(CUDA、cuDNN)、互连技术(NVLink、InfiniBand)、网络架构(Spectrum-X),再到整机系统(DGX),NVIDIA掌控了每一层的定义权。这种端到端控制使其能实现年度系统级更新,而竞争对手困在PCIe、CXL等碎片化行业标准中,难以同步演进。 其成功并非源于某颗芯片的峰值性能,而是全栈协同带来的有效算力密度。微软Azure上的首台AI超算与NVIDIA基准测试结果高度一致,正是因为系统由NVIDIA端到端设计。相比之下,仅提供芯片的供应商无法保证跨层优化,导致实际训练效率大幅衰减。这解释了为何云厂商宁愿预付数十亿美元锁定NVIDIA未来产能:如果说全栈架构是NVIDIA的内功,那么“AI工厂”概念则是其对外输出的商业语言。Jensen刻意摒弃“数据中心”这一传统术语,代之以“工厂”——在AI工厂中,核心指标不再是FLOPS或TOPS,而是每瓦Token产出(Tokens per Watt)。电力、土地、先进封装(CoWoS)成为稀缺资源,工厂产能受限于1GW或2.3GW的电力配额。在此约束下,计算架构的选择直接决定企业明年营收规模。Jensen直言:“你不会把500亿美元压在别人的PPT上。”选择错误的技术栈,意味着在同等电力投入下损失90%的有效产出。 Jensen断言:“未来不存在非智能体化的软件。”这意味着软件公司将从“工具授权”转向“数字工人租赁”。Cadence或Synopsys不再仅出售EDA工具,而是提供“擅长使用这些工具的AI专家”。IT行业2万亿美元的市场规模,将因Token消耗而指数级扩张。Anthropic若获得3倍算力,营收即增长3倍——主权AI已成为国家战略,各国竞相建设AI基础设施,因为拒绝智能化等同于经济自杀。NVIDIA的客户名单,已从科技公司扩展至主权财富基金和国家级实验室。2025年,沙特NEOM新城宣布投资500亿美元建设AI城,其核心基础设施全部基于NVIDIA DGX Cloud;阿联酋则通过主权基金直接注资NVIDIA生态企业。算力,正成为21世纪的“工业用电”,是衡量国家工业化水平的新标尺。Jensen将AI发展划分为3个清晰拐点,每个拐点都带来计算需求的量级跃升,且后一阶段的需求呈指数级超越前一阶段:典型场景如问答、文本摘要,Token消耗量级在10^3–10^4。 以OpenAI o1模型为标志,引入慢思考、自纠错与RAG(检索增强生成)。计算需求提升1000倍,因其需实时检索知识库、验证逻辑一致性、多轮修正输出。例如,o1在解决数学竞赛题时,内部推理链可达数百步,Token消耗激增至10^6–10^7。以OpenClaw为里程碑,AI具备规划、工具调用、持续运行能力。Token消耗量激增百万倍,因为智能体在后台持续工作——OpenClaw在3周内超越Linux 30年的下载量,其增长曲线在半对数坐标下呈垂直上升。NVIDIA内部已部署大量OpenClaw处理写作、编码、研究,公司算力需求因此急剧攀升。 不是模型训练的一次性投入,而是智能体持续运行的永久性消耗。每家企业都将运营自己的“数字劳动力”,而Token消耗将成为IT预算的核心组成部分。据测算,一家中型银行若部署1000个金融智能体,年Token消耗将达10^15量级,对应算力需求相当于数千颗H100 GPU全年满载运行。面对内存带宽、电力供应、CoWoS先进封装等多重供应链约束,Jensen的态度出人意料:“我喜欢约束。”其每瓦Token产出领先对手一个数量级,意味着在1GW电力限制下,客户选择NVIDIA可获得10倍营收。 截至2025年底,NVIDIA持有850亿美元现金及等价物,利用史上最强的经营现金流,提前锁定整个供应链:从美光/三星的HBM3e DRAM、台积电的4NP晶圆、CoWoS封装产能,到铜材、MLCC电容等二级物料。当Satya Nadella要求微软建设数GW AI算力时,Jensen能立即承诺交付,因为所有环节均已保障。这种能力使NVIDIA从芯片供应商升级为“AI工厂总承包商”——客户只需提出算力需求与电力配额,NVIDIA负责从芯片到系统的全栈交付。 300亿美元投资OpenAI、100亿注资Anthropic,不仅是财务行为,更是生态卡位。OpenAI从Azure扩展至AWS和OCI,Anthropic同时在Azure与AWS运行。客户扩容(现有客户算力需求年增300%)、多云交叉(单客户采购多个云平台)、新兴实验室(如微软MSL、xAI)——2025年,NVIDIA来自云厂商的收入占比已达68%,且客户集中度(前五大客户)从2022年的45%降至2025年的32%,显示生态健康度持续改善。当智能体化成为数字世界的基础设施,AI的下一前沿是物理意识。Jensen指出,真正的智能需理解重力、碰撞、因果、物体恒存性——La Proteina:蛋白质结构与功能预测引擎。 与礼来(Lilly)共建的联合创新实验室,标志着AI将重构生命科学研发流程。传统药物发现周期长达10年、成本26亿美元,而通过NVIDIA的Omniverse+BioNeMo平台,分子筛选与临床前验证可压缩至18个月。物理AI不仅是让机器人动起来,更是通过多物理场耦合模拟,加速药物发现、材料设计、工业制造。 免费提供模型权重与工具链(如Isaac Sim、Modulus),旨在将全行业纳入其技术栈。这种“开源上层、闭源底层”的模式,进一步巩固其生态统治力:开发者依赖CUDA生态,企业依赖DGX系统,国家依赖AI主权方案,形成多层次锁定。Jensen Huang的演讲,本质上是一份新经济宪法的宣读。NVIDIA的崛起,不是芯片的胜利,而是系统工程对碎片化生态的降维打击。当竞争对手还在优化单一组件(如FP8精度、内存带宽)时,NVIDIA已重新定义了整个计算工厂的架构。这种能力,源于33年对算法与系统的偏执深耕,成于对约束条件的战略利用。 未来十年,AI竞赛将不再是“谁有更多GPU”,而是“谁拥有更高效的AI工厂”。而在这场竞赛中,NVIDIA既是裁判,也是唯一的总承包商。正如Jensen所言:“你无法阻挡这支股票。”因为阻挡它,等于阻挡算力转化为营收的必然趋势——NVIDIA的价值锚点,不在晶圆厂产能,而在其全栈协同所带来的“有效算力密度”与“生态锁定强度”。

文中观点仅为作者观点,不代表本平台立场

各位读者朋友,公众号改了推送规则,如果您还希望第一时间收到我们推送的文章,请记得给北大纵横公众号设置星标。 点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”

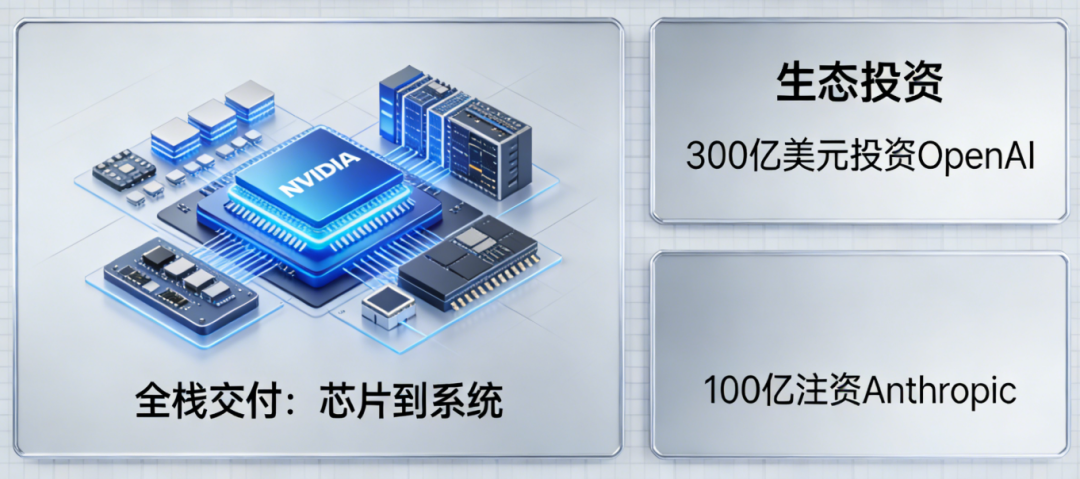

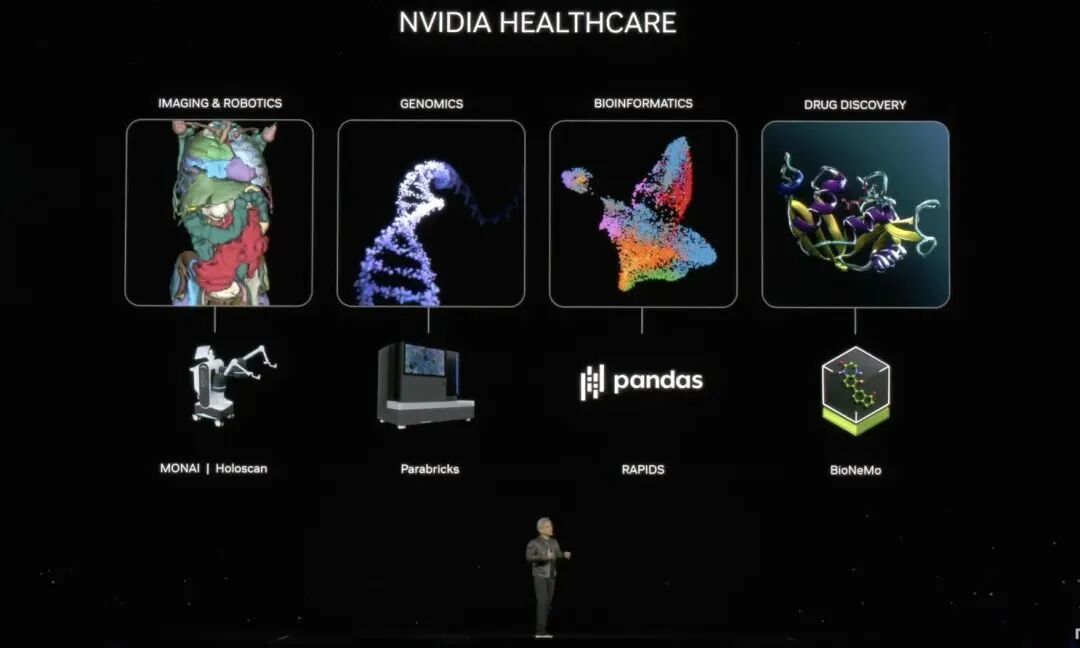

点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”