淘工位首页/行业资讯/Anthropic CEO:星火未燃,当安全执念错失C端浪潮,数据护城河已然崩塌!/ Anthropic CEO:星火未燃,当安全执念错失C端浪潮,数据护城河已然崩塌!

2026-02-26 00:00:00

文章转载自"北大纵横"

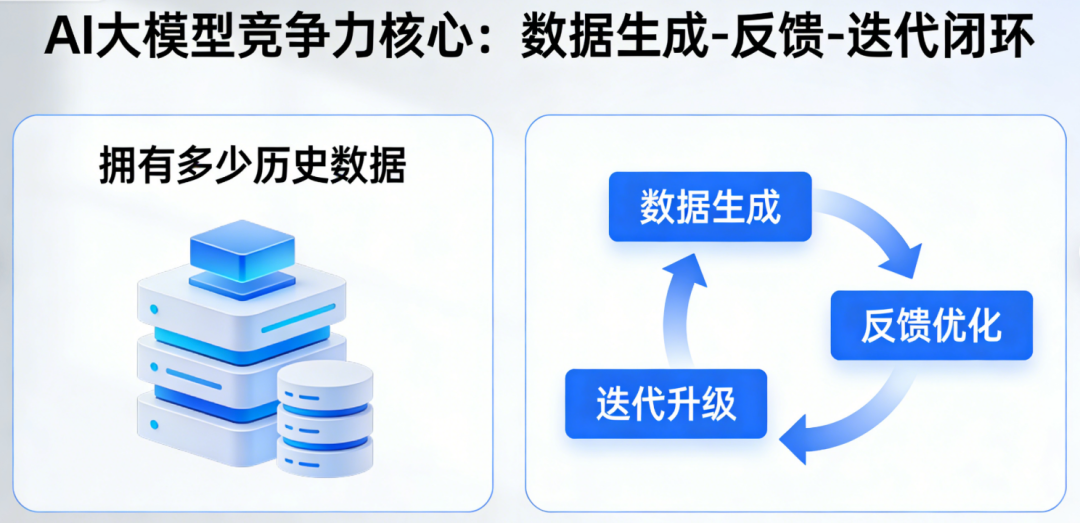

将时间的指针回拨到AI大模型创业的萌芽期,彼时,旧金山湾区的秋意尚未散尽,Anthropic办公室内却已弥漫着一种近乎悲壮的静默。 Dario Amodei——这位曾主导OpenAI早期安全研究、后因理念分歧出走创立Anthropic的AI科学家——正面临一个足以改写行业格局的抉择: Claude 1的早期版本已具备与ChatGPT相当的语言理解与生成能力,但团队最终决定暂缓发布。 “我们担心这会引发军备竞赛,而我们尚未准备好确保其安全。” 然而,就因为这神之一手的暂停键,如同在黎明前掐灭了即将燎原的星火。 短短数周后,OpenAI正式推出ChatGPT,全球用户以日均百万级的速度涌入,三个月内突破一亿活跃用户,彻底重塑公众对人工智能的认知边界。 而Anthropic,这家由前OpenAI核心成员创立、以“将AGI做对”为使命的公司,却因一次出于伦理审慎的自我克制,永久失去了定义消费级AI体验的战略窗口。 这不仅是一次商业时机的错失,更揭示了一个深层结构性转变:在技术迭代速度超越传统护城河构建周期的时代,曾经坚不可摧的竞争壁垒正在加速崩塌。任何可能引发不可控后果的功能,即便技术上可行,也必须暂缓。 2022年末,当Claude 1展现出接近GPT-3.5的能力时,团队评估认为,若此时发布,将刺激其他公司加速竞逐,导致安全机制被边缘化。“也许世界因此多获得了几个月时间,” Dario事后坦言,“但那在商业上代价很大。” 问题在于,C端市场从来不是由“正确性”决定的,而是由速度、体验与网络效应共同塑造的。Meta虽在2023年开源Llama系列,技术指标屡创新高,却始终未能在大众认知中撼动ChatGPT的地位; Google凭借搜索帝国与数十亿用户基础,在Bard(后更名为Gemini)初期因过度谨慎而反应迟缓,直到2024年才通过深度整合Workspace勉强追回部分份额Anthropic的困境,本质上是理想主义与市场现实之间的结构性错配。 他们赌的是社会能在“多出的几个月”里建立AI治理共识,赌的是监管能及时跟上技术爆炸。 但现实是,ChatGTP引爆的不仅是技术热情,更是资本、媒体与用户注意力的全面转向。 安全讨论迅速被功能迭代、插件生态与API经济所淹没。 当整个行业进入“青春期式狂飙”,审慎反而成了战略负债。 星火未燃,非因无光,而因在错误的时间选择了正确的沉默。它们不再依赖爬取维基百科或Reddit,而是通过强化学习(RLHF、RFT等)在动态环境中自我生成高质量训练信号。 例如,Claude在数学推理任务中并非调用历史题库,而是通过模拟解题过程生成新数据; 这意味着,真正的竞争力不在于“拥有多少历史数据”,而在于构建高效的数据生成—反馈—迭代闭环的能力。 企业宁愿为GPT-4或Claude 3支付十倍溢价,也不愿使用性能略逊的廉价替代品。 在这种格局下,数据量的优势若不能转化为质的飞跃,便毫无意义。 正如Dario所言:“你可以雇佣世界上最好的程序员,也可以雇佣第10,000名最好的——价格不太重要。” 同理,模型性能的微小差距,可能导致商业价值的巨大鸿沟。 尽管Dario曾贬低部分中国模型“仅为跑分优化”,但不可否认,DeepSeek、GLM-5、Qwen-Max等通过蒸馏、合成数据与高效微调,已在金融、法律、医疗等垂直领域逼近闭源模型表现。 蒸馏并非抄袭,而是一种合法的知识迁移机制——连Anthropic自身也在内部使用类似技术压缩模型。 火焰已起,旧日以数据为砖石砌成的护城河,在高温中蒸发殆尽。当前大模型仍是“无身之智”(disembodied intelligence)——它们无法触摸物体、无法在真实环境中移动、无法处理需要现场判断与人际信任的复杂任务。 因此,任何涉及实体操作、制度嵌入或情感交互的领域,人类依然不可替代。 Dario指出,若企业仅停留在“操作蒸汽机”层面——即执行标准化编码、测试或运维任务——终将被AI Agent取代。 但他同时强调,那些兼具技术实施、本地合规理解与客户关系网络的公司,反而能借AI之力放大优势。 “理解制度如何运作,能够把技术整合进机构体系中”——这种系统集成能力,恰恰是纯AI难以复制的。 AI在医学影像识别上的准确率已超越人类专家,但患者仍需要医生面对面解释结果、安抚焦虑、协调多学科治疗方案。 最技术化的环节被自动化,但底层的人类技能需求反而上升。当编码、写作、数据分析等认知劳动被自动化,那些关乎共情、责任、创造力与跨域整合的“人性要素”,反而成为新的护城河。 未来的赢家,不是拥有最多数据的公司,而是最懂得如何将AI嵌入人类工作流、增强而非替代人的组织。 “每隔两到三个月,大模型能力就会上一个新台阶,新一轮的创业机会也会随之涌现。” API经济并未走向商品化,反而因能力边界的持续扩展而愈发繁荣。 每一个新模型的发布,都像打开一扇通往未知领域的大门——昨天不可能的应用,今天突然变得可行。 仅仅包装一个聊天界面、调用几个提示词(prompt),这样的产品毫无壁垒,随时可能被大模型厂商内置功能或竞争对手复制。 深入垂直场景,构建领域知识、工作流整合与客户信任的复合护城河。Dario作为生物物理学家出身,深知药物研发的复杂性远超通用AI的理解范畴。 一家专注于多肽设计的初创公司,若能将Claude的推理能力与自有实验平台、专家知识库、临床反馈机制深度融合,便能形成Anthropic无法轻易复制的专业壁垒。 模型只是引擎,真正的护城河在于领域数据闭环+专家判断+实验验证的三位一体。 同样,在金融服务、法律、教育等领域,合规要求、本地化规则与长期客户关系构成了天然门槛。 AI不是取代者,而是超级助手——帮助律师将80%的合同审查自动化,从而聚焦于谈判策略; 帮助教师将作业批改交给模型,转而设计个性化学习路径。 在一个AI可生成任意文本、图像甚至视频的世界,“不被欺骗的街头智慧”比以往任何时候都珍贵。 教育体系必须从知识灌输转向思维训练,培养下一代辨别真伪、独立判断、追问因果的能力。 熔炉已热,新质正在诞生——不是取代人类的机器,而是增强人类的伙伴。回望Anthropic的选择,我们既看到理想主义的悲壮,也看到时代洪流的无情。他们因安全理念按下Claude 1的发布键,如同在长夜将尽时熄灭了手中的火炬。这一举动或许为世界争取了短暂的喘息,却也让一家本可定义C端AI形态的公司退居幕后。 AI对“纯技术岗位”的冲击,正倒逼人类回归其不可替代的核心价值。 “如果你把少量经验观察与第一性原理思考结合起来,就可以预测未来。” 前方既有《Machines of Loving Grace》描绘的乌托邦——AI治愈疾病、解决气候危机、释放人类创造力; 也有《The Adolescence of Technology》警示的深渊——能力退化、操纵加剧、失控风险。 当星火重燃,愿我们不再因恐惧而熄灭它,也不因狂热而放任它。 唯有在长夜与烈日之间,找到那条审慎而坚定的道路——让技术服务于人,而非让人沦为技术的附庸。

文中观点仅为作者观点,不代表本平台立场

各位读者朋友,公众号改了推送规则,如果您还希望第一时间收到我们推送的文章,请记得给北大纵横公众号设置星标。 点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。

点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。