淘工位首页/行业资讯/OpenClaw 走红背后:AI Coding 的真实瓶颈与团队协作的秩序重建/ OpenClaw 走红背后:AI Coding 的真实瓶颈与团队协作的秩序重建

2026-03-16 00:00:00

文章转载自"北大纵横"

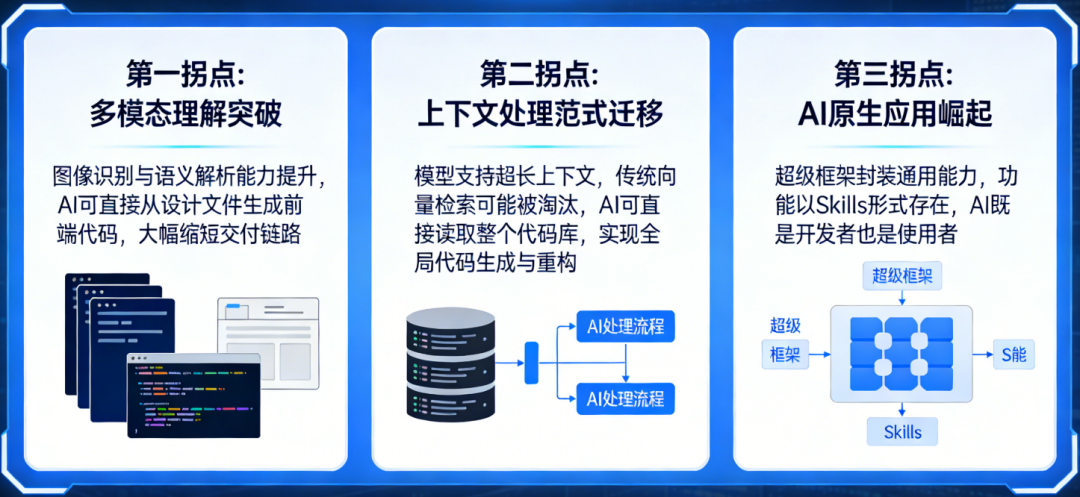

2026年3月,北京中关村一间创业公司办公室内,一台闲置的 Mac mini 屏幕上闪烁着绿色终端窗口——一只名为"龙虾"的智能体正自主执行任务。OpenClaw 的爆火,让"养虾"成为技术圈新梗,也悄然揭开一个更深层的问题:当 AI 不仅能写代码,还能自主规划、调用工具、反思错误甚至扩展自身能力时,我们沿袭数十年的研发范式、协作逻辑乃至责任边界,是否正在系统性崩塌?作为长期观察AI科技产业和软件工程演进的研究者,笔者发现,围绕 OpenClaw 的讨论早已超越"工具好不好用"的表层。它像一把解剖刀,精准切入当前 AI Coding 实践中的结构性病灶:需求模糊导致生成失控、代码质量缺乏闭环验证、团队协作缺乏统一规范、安全边界形同虚设。是继续埋头敲代码,还是转向更高维的架构设计、规范制定与系统治理?本文将从 OpenClaw 的技术本质出发,层层剖析其走红背后的结构性动因,并聚焦于 AI Coding 在团队落地时遭遇的真实困境。我们将看到,真正的瓶颈从来不是模型能力,而是工程化思维的缺失;最终,我们会提出一套可操作的"护栏体系",帮助团队在效率与可控之间找到平衡点。许多媒体将 OpenClaw 描绘成"人人可用的 AI 助手",这本身就是一场认知误导。要真正驾驭它,用户必须熟悉 JSON 配置、具备排障能力,并持续调试和优化 skill。它的门槛不在于界面复杂,而在于对系统思维的要求——你必须理解 Agent 如何规划任务、如何调用工具、如何管理记忆。OpenClaw 的核心创新,在于打通了聊天工具、桌面环境与技能系统。用户通过 IM 发送指令,Agent 接收后在本地电脑上执行操作,比如自动爬取数据、生成报告、监控 CI/CD 流水线。这种"远程驱动本地"的模式,解决了传统桌面 Agent 无法跨设备协同的问题。但它的真正威力,来自于Programmatic Tool Calling (PTC) 架构。不同于传统的 MCP 需要预先注册工具,PTC 允许 Agent 在运行时动态生成 Python 脚本并在沙盒中执行。这意味着,当遇到未知任务时,Agent 可以"自学成才"——上网搜索资料、编写新 skill、测试并迭代,最终完成目标。MITRE ATLAS 团队 2026 年 2 月发布的调查报告显示:安全研究人员发现了超过 4.2 万个暴露在公共互联网上的 OpenClaw 实例,其中 90% 以上可以被攻击者直接绕过身份验证,窃取 API 密钥和私人通讯记录。就连 Meta 实验室的 AI 对齐总监 Summer Yue,在为 OpenClaw 开放邮箱权限后,也因 AI 丢失约束指令,导致收件箱被批量清空。OpenClaw 执行任务时消耗 Token 的速率极快,普通用户中度使用一个月费用轻松过百,重度玩家动辄成百上千。某云厂商负责人透露,从用户调研来看,用户中 有 90% 都在"养龙虾"。更值得警惕的是,OpenClaw 的配置极不稳定。多位用户反馈,JSON 文件在重启后可能被自动修改甚至损坏,浏览器自动化也常因页面结构变化而失效。如果说 OpenClaw 是 Agent 的外显形态,那么 AI Coding 则是其内核能力。AI 写代码的速度越快,团队陷入混乱的风险就越高。自然语言天生模糊,而 AI 基于概率推断,极易产生幻觉。"能跑"的代码越来越容易得到,但"该不该这样跑"变得更难判断。例如,团队要求开发"在线截图工具",AI 可能直接调用第三方 API,完全绕过预设的技术方案。这种"功能正确但路径错误"的输出,看似高效,实则埋下技术债。主流大模型训练数据多来自 GitHub 开源项目,偏好国外技术栈。当企业使用私有框架或内部组件库时,AI 往往强行套用外部模式,导致代码与现有体系格格不入。许多团队陷入"只要功能跑通就合并"的陷阱,不再认真审查 AI 代码。技术圈甚至出现一个讽刺现象:第一批 Vibe Coding 的受害者,如今正招聘"氛围编程代码修复师"来清理烂摊子。而 arXiv 两篇学术论文系统论述的 Spec-Driven Development 方法,正是对症良药。将 PRD 或口头需求转化为标准化 SPEC(如使用 EARS 规则:"当用户登录时,系统应在3秒内验证凭证并跳转首页");架构师评审技术方案,确保接口、数据模型、技术栈合理;这套流程的价值在于,它把模糊的"Vibe"转化为清晰的"契约"。多位实践者表示,采用 SPEC 后,AI 代码的一次通过率显著提升,且长期维护成本大幅降低。即使使用 Given-When-Then 验收条件,AI 仍可能自信地认为自己实现了需求,而实际逻辑存在偏差。这说明,AI 可以辅助编码,但无法替代人类对业务本质的理解。OpenClaw 最初的魅力,在于其个人生产力属性。OpenClaw 通过 Markdown 文件存储记忆,采用分层存储方案:短期记忆保留会话上下文,长期记忆通过语义索引支持模糊查询。但这些知识仅限个人使用,团队成员各自"养虾",积累的经验无法共享。理想状态应是构建企业级记忆库,让 Agent 能检索历史决策、技术方案和踩坑记录。不同成员使用的 AI 工具、提示词模板、Lint 规则各不相同,导致代码风格混乱。多位实践者强调,团队必须建立统一的"Constitution"——包括 Skills 库、CI 规则、编码规范等,确保产出一致性。arXiv 学术论文提出的"Constitutional Spec-Driven Development"进一步系统化了这一思路,将非协商的安全原则嵌入规范层。AI 是工具,开发者必须对功能一致性、架构合规性、安全性进行最终审查。这意味着,代码 CR 不仅不能取消,反而要强化——需求层:强制使用 EARS 或类似方法结构化需求,消除歧义;执行层:通过 TDD 约束生成过程,所有 AI 代码必须通过自动生成的测试;某科技公司的实践颇具启发性:他们不让 AI 直接修改代码,而是生成"设计文档级修改方案",包含具体代码片段和 HTML 报告。开发者勾选认可的部分后,再由 IDE 插件生成完整代码。这种方式下,60%–80% 的片段可直接复用,既保留了 AI 效率,又确保了人类控制权。展望未来 6–12 个月,AI Coding 的演进将呈现三大拐点。一旦图像识别与语义解析能力提升,AI 将能直接从设计文件生成前端代码,大幅缩短交付链路。AI 可直接读取整个代码库,实现更全局的代码生成与重构。有实践者预言,未来应用可能不再为人设计,而是为 AI 设计——超级框架封装通用能力,功能以 Skills 形式存在,AI 既是开发者也是使用者。在开发过程中,不仅要完成功能,还要为代码库留下知识和规范。老项目尤其如此——通过 DeepWiki 工具分析热点模块,优先整理高频修改区域的文档,用 20% 的投入解决 80% 的问题。它像一面棱镜,折射出 AI 时代研发工作的本质变迁:编写具体代码的价值正在稀释,而定义规范、设计架构、制定流程的能力愈发珍贵。未来的程序员,或许不再需要手写每一行代码,但必须精通如何让 AI 在正确轨道上奔跑。正如实践者所言:"Peter 几乎全靠 AI 开发了 OpenClaw,但他关注的不是代码,而是规范文档。"在 QCon 2026 北京站即将召开之际,这场关于 Agent 与 AI Coding 的讨论,终将指向一个共识:

文中观点仅为作者观点,不代表本平台立场

各位读者朋友,公众号改了推送规则,如果您还希望第一时间收到我们推送的文章,请记得给北大纵横公众号设置星标。 点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。

点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。