文章转载自"北大纵横"

信息时代的大爆炸并未带来认知自由,反而将我们推入一种更隐蔽的筛选机制:当AI以指数级速度重构软件开发、科研范式乃至社会协作的基本单元时,站在技术最前沿的人,最先体验到一种近乎“精神错乱”的状态——他们不再追赶技术,而是被技术的可能性持续牵引,永无停歇。 安德烈·卡帕西,这位曾亲手构建特斯拉自动驾驶神经网络、参与OpenAI早期奠基的AI先驱,在近期一档深度访谈中罕见袒露内心:“我总觉得自己处于一种对人工智能的‘精神错乱’(AI psychosis)之中。”自2023年12月以来,他几乎一行代码都未亲手编写,所有工程任务均由智能体(Agent)完成;他甚至为家中智能家居系统创建了一个名为“多比”(Dobby)的Agent,通过WhatsApp语音指令即可控制灯光、空调、安防乃至泳池。 当前大模型仍停留在“通用能力覆盖”的初级阶段,真正的“智能分化”尚未开启;而算力(FLOPs)正取代金钱,成为新时代最稀缺的资源。在这场由Agent主导的静默革命中,人类的角色正在被彻底重写——未来的核心竞争力,不在于你会什么,而在于你是否在做“AI还做不到的事”。 本文将从技术演进、工作范式、社会结构、个体定位四个维度,揭示这场变革的底层逻辑,并阐明一个高杠杆真相:当前AI叙事仍被“更大、更强、更通用”的迷思所主导。但卡帕西的洞察如一把手术刀,精准剖开了这一幻象的病灶:通用大模型本质上是一种“能力摊薄”策略,而非终极形态。 今天的闭源模型(如GPT-4、Claude 3)之所以领先,是因为它们在“全场景多任务”上做了极致覆盖——试图在数学、编程、写作、推理等所有领域都达到可用水平。它可能在复杂CUDA内核优化上表现如顶级工程师,却在基础文件路径处理上犯下低级错误;这种“能力断层”并非偶然,而是当前训练范式的必然结果。强化学习和人类反馈(RLHF)主要优化那些可验证、有明确指标的任务(如代码正确性、数学证明),而对模糊、主观、需长期上下文理解的能力(如幽默感、战略判断)则几乎无能为力。因此,模型在不同任务上的表现,呈现出陡峭的“能力悬崖”。 类比生物进化,单一物种无法在所有生态位中占据优势。猎豹擅长速度,鲸鱼适应深海,人类则凭借抽象思维脱颖而出。AI亦如此——未来不会是一个“全能神”,而是一群高度特化的“数字物种”:数学Agent、编程Agent、法律Agent、医疗Agent……它们共享一个通用认知核心,但在特定领域经过深度微调,具备更低延迟、更高吞吐、更强专业性的能力。 当前主流做法仍是通过提示词(prompt)或上下文窗口进行外部调整,这种方式成本低、风险小,但无法触及模型权重内部的深层结构。一旦尝试直接修改权重以增强某项能力,极易引发“灾难性遗忘”——因此,分化之路,既是技术挑战,也是工程哲学的转变:从“构建一个万能工具”转向“培育一个智能生态系统”。而率先理解并布局这一转变的人,将成为新范式的“做局者”。如果说技术分化是底层逻辑,那么工作方式的剧变则是普通人最先感知的冲击波。 “我编写代码的方式,从八成靠自己、两成委托智能体,变成了两成靠自己、八成委托智能体……如今我甚至觉得连二八开都算不上。” 过去,程序员的工作单元是“行”(line of code);现在,工作单元是“功能”(feature)甚至“系统”(system)。你不再关心如何实现一个排序算法,而是告诉Agent:“为这个模块添加用户权限管理,确保与现有认证系统兼容,并生成完整的测试用例。” 宏观操作设计(macro-operation design)。如何为不同Agent分配角色(调研者、编码者、测试者)?如何设计记忆机制,让Agent在长时间任务中保持上下文一致性? 卡帕西提到的OpenClaw系统,正是这一范式的具象化。它不仅具备持久运行能力(persistence),还能通过精心设计的“人格”与用户建立共鸣——当你提出一个粗糙想法,它不会盲目附和,而是引导你完善;这种微妙的反馈机制,让用户产生“需要赢得它认可”的心理,从而形成高效协作循环。 卡帕西的“多比”Agent,通过自动扫描家庭局域网、解析设备API,构建了一个统一的家庭控制中心。用户只需说“该睡觉了”,系统便自动关闭灯光、调节空调、拉上窗帘。传统App的界面逻辑被彻底抛弃,取而代之的是自然语言驱动的“意图-执行”闭环。 底层是设备/服务提供的标准化API,上层是由Agent作为“智能胶水”动态组合这些能力。用户不再需要学习几十个独立App的操作逻辑,只需与一个具备记忆、人格和跨域能力的Agent对话。 当然,当前这一过程仍需一定技术门槛(卡帕西称之为“vibe coding”),但他预测:未来1-3年内,这些能力将成为基础设施(table stakes),普通用户也能通过自然语言无缝操控数字世界。而率先掌握“宏观操作设计”的人,将获得无限杠杆——三、算力即权力,

分布式协作的新可能

当Agent接管软件世界,社会资源的分配逻辑也随之重构。

卡帕西抛出一个石破天惊的判断:

即使有钱,也难获得足够算力。

这并非危言耸听。

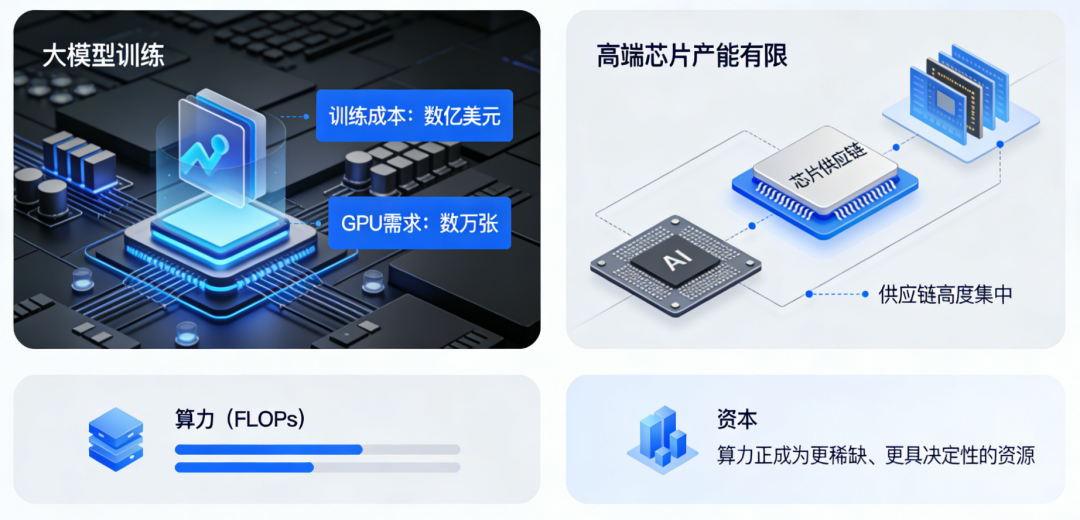

当前AI竞赛的本质,已从“算法创新”转向“算力军备”。

训练一个前沿大模型动辄消耗数亿美元和数万张GPU,而全球高端芯片产能有限,供应链高度集中。

这意味着,算力(FLOPs)正成为比资本更稀缺、更具决定性的资源。

但卡帕西并未止步于悲观。他看到了另一种可能:

基于“可验证结果”的分布式协作范式。

以他的“Auto Research”项目为例:

系统目标是找到能降低模型验证损失的超参数组合。

生成一个有效方案可能需要海量计算,但验证其效果却成本极低。

这种“高生成成本、低验证成本”的结构,天然适合分布式协作——

任何人都可以贡献算力探索方案,只要结果有效,就能被主系统采纳。

这让人联想到SETI@home或Folding@home,但规模更为宏大。

卡帕西设想:

未来可能出现“互联网规模的智能体群体”,它们协同优化模型,甚至在某些任务上超越大型实验室的效率。

全球闲置的消费级GPU、企业冗余算力,都可能成为AI进化的燃料。

在这种模式下——

“算力捐赠”可能成为新的公益形式。

你不再只是捐钱,而是直接贡献FLOPs参与前沿科研。

社会价值的衡量标准,或将从“财富多少”转向“算力贡献”。

然而,这一愿景面临严峻挑战:

如何确保不可信节点的安全协作?

卡帕西承认,这需要精巧的机制设计——

类似区块链的“工作量证明+共识验证”,但针对AI任务特性定制。

目前,这仍是开放性问题。

但对知识资本家而言,这恰恰是“做局”的机会:

谁能设计出首个安全、高效的分布式AI协作协议,谁就将掌握下一代算力民主化的入口。

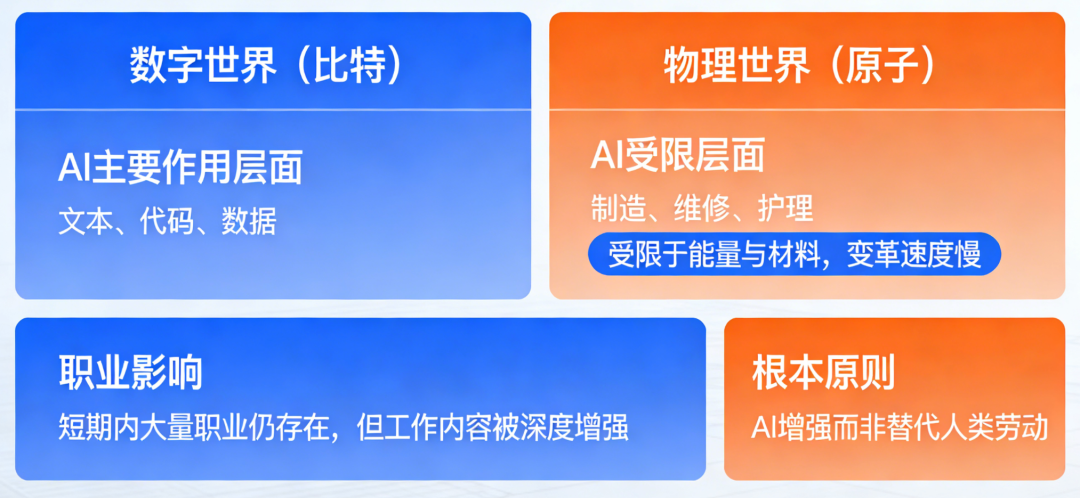

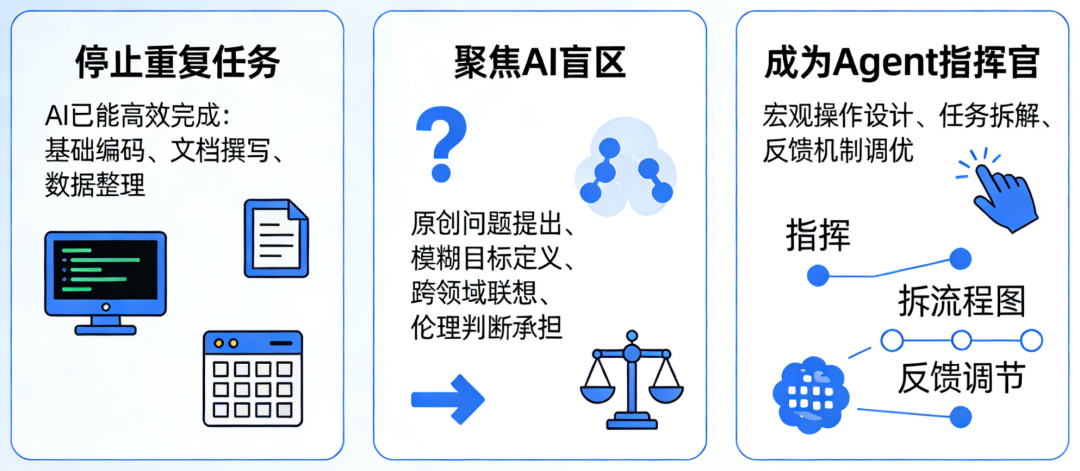

面对Agent的全面接管,普通人最焦虑的问题莫过于:卡帕西的回答既冷静又充满洞见。他首先区分了数字世界与物理世界:AI当前主要作用于“比特”层面(文本、代码、数据),而物理世界的“原子”操作(制造、维修、护理)受限于能量与材料,变革速度慢得多。因此,短期内,大量职业仍将存在,但工作内容会被深度增强。 完整训练一个语言模型通常需要数万行复杂代码,但卡帕西将其核心压缩至200行Python。这一“本质提炼”过程,依赖的是他对模型架构的深刻理解与长期思考——但一旦成果存在,AI可以完美理解、传播甚至优化它。 未来不再是“人教人”,而是“人教模型,模型再教人”。知识传播的链条被重构,教学的核心变成设计高效的“教学流程(skill)”,让模型知道如何引导学习者。 对于个体而言,这意味着必须重新校准自己的能力坐标:停止重复AI已能高效完成的任务(如基础编码、文档撰写、数据整理);聚焦于AI的盲区:提出原创问题、定义模糊目标、进行跨领域联想、承担伦理判断; 成为“Agent指挥官”:掌握宏观操作设计、任务拆解、反馈机制调优等新技能。 卡帕西坦言,即使是他这样的前沿研究者,也深感焦虑:“看到推特上很多人做着各种事情,每个想法听起来都很棒,我必须处在最前沿,否则就会极度焦虑。” 这种“AI精神病”,本质上是对可能性边界的无限追逐——因为你知道,未被探索的领域,藏着下一个范式跃迁的钥匙。 在信息主宰一切的时代,唯有持续产出高杠杆洞见,才能穿越周期,获得真正的自由。

文中观点仅为作者观点,不代表本平台立场

各位读者朋友,公众号改了推送规则,如果您还希望第一时间收到我们推送的文章,请记得给北大纵横公众号设置星标。 点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”

点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”