旧金山湾区一间不起眼的办公室里,一位营销总监正独自面对屏幕。

他没有撰写文案、制作PPT,也没有参加视频会议——

而是在“指挥”一支由40个AI智能体组成的虚拟团队。

这支队伍中,有负责内容生成的“撰稿人”,有实时分析用户行为数据的“分析师”,甚至还有一个每周自动复盘绩效、提出优化建议的“AI教练”。

他的月度支出仅为500美元,却完成了相当于一个5万美元/月人类外包团队的工作量。

这不是未来预言,而是正在发生的现实。

然而,绝大多数职场人对此毫无感知。

他们仍将大模型视为“更聪明的搜索引擎”或“写邮件的高级助理”,思维仍停留在2022年的提示词工程时代。

这种认知代差,正在悄然重塑个体生产力的分布曲线——

不是线性拉开差距,而是结构性地制造断层。

因此,我们不禁好奇:

前1%的AI使用者与普通用户之间的本质差异,究竟源于技巧层面的熟练度,还是认知范式的根本不同?

答案是后者。

这场差距并非源于“会不会写提示词”,而在于是否完成了一场从“工具使用者”到“智能协作者”的认知跃迁。

我们将以基本面研究的方法论,对这一现象进行系统解剖:

首先厘清大众误判的表象,继而通过四个维度揭示认知鸿沟的深层结构,再诊断其背后的机制性病灶,最终提出可落地的认知升级路径。

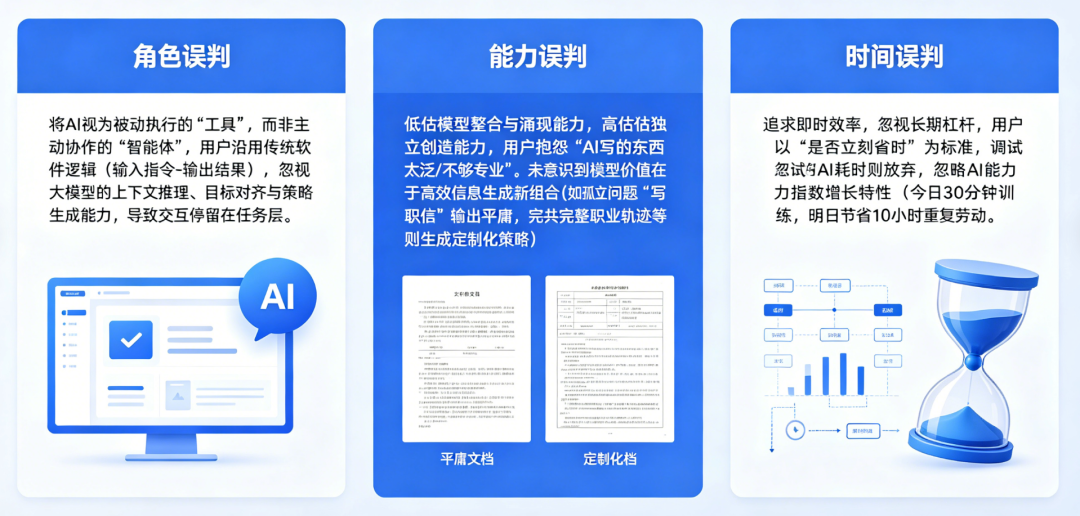

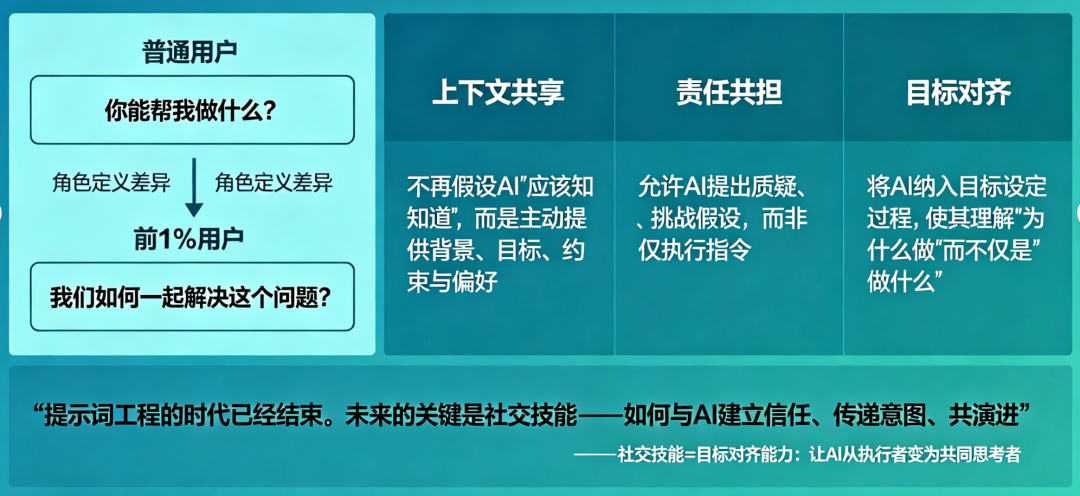

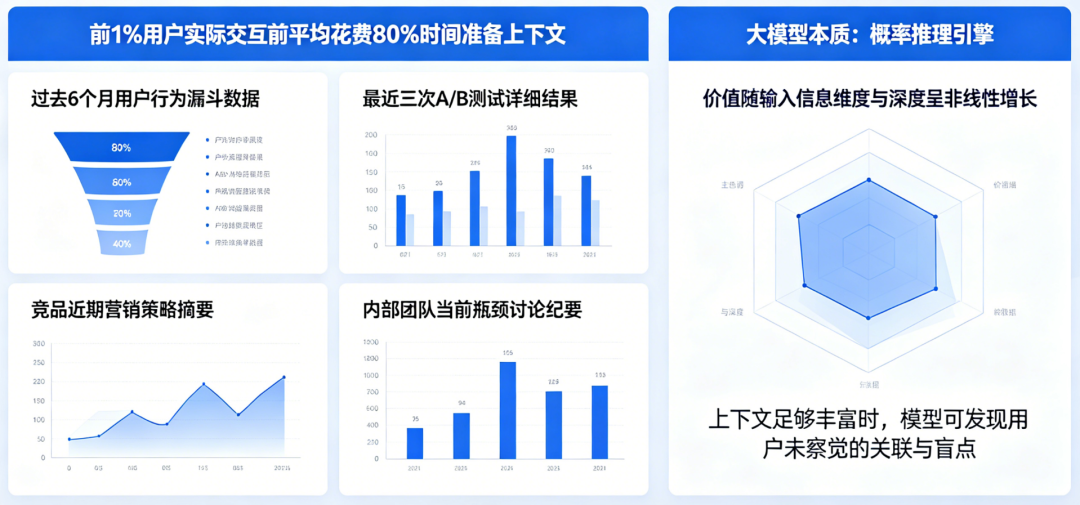

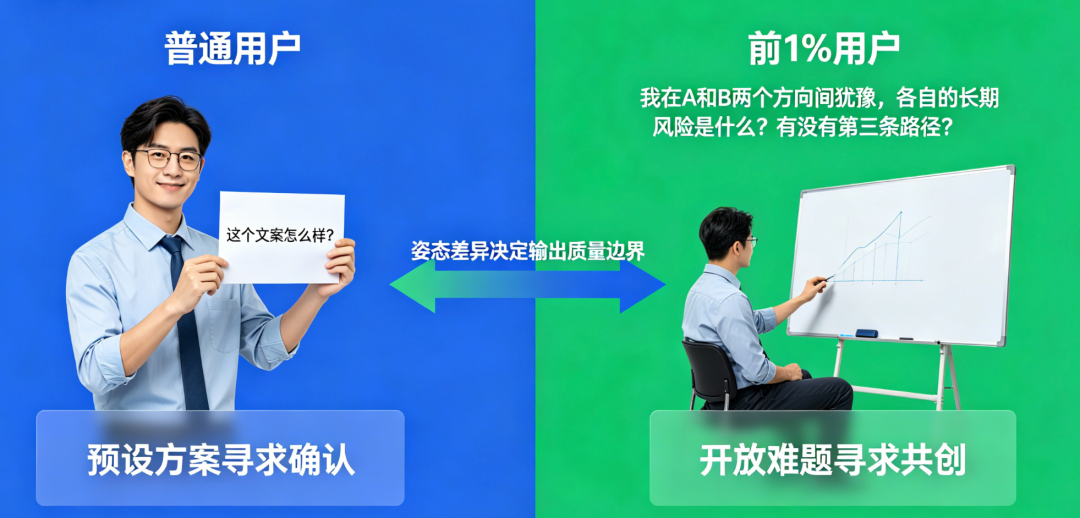

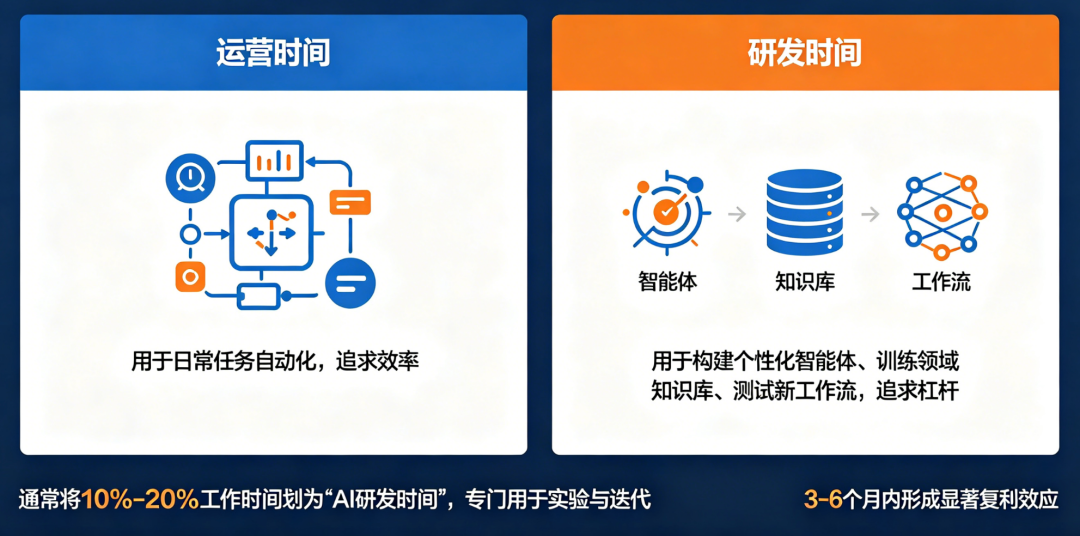

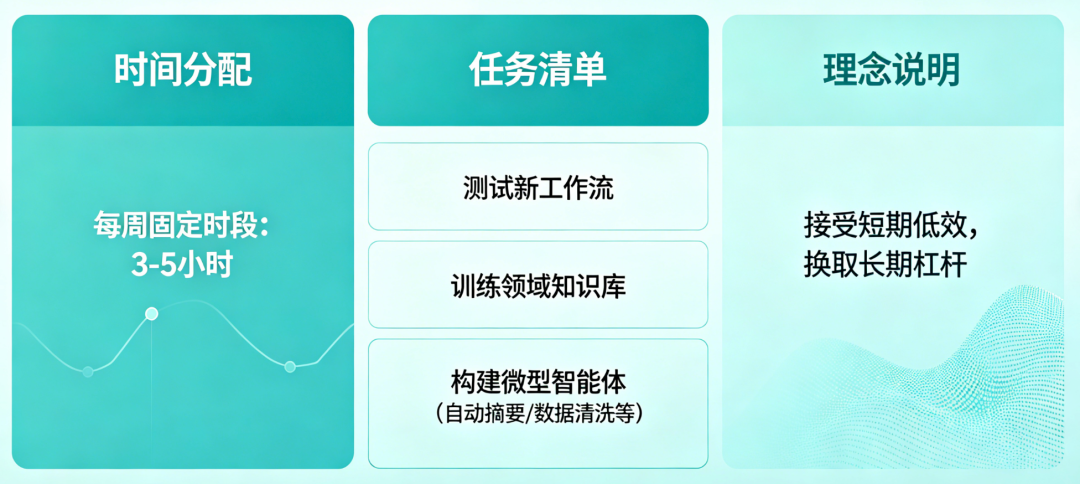

要理解前1%的思维模式,必须先看清主流认知的局限。当前市场对AI的普遍理解,存在三个相互强化的误判:第一,角色误判:将AI视为被动执行的“工具”,而非主动协作的“智能体”。输入指令,输出结果。他们期待AI像Excel一样精准响应公式,却忽视了现代大模型具备上下文推理、目标对齐与策略生成的能力。第二,能力误判:低估模型的整合与涌现能力,高估其独立创造能力。用户常抱怨“AI写的东西太泛”或“不够专业”,却未意识到:模型的价值不在于凭空创造,而在于高效整合已有信息并生成新组合。当输入仅是一个孤立问题(如“帮我写封求职信”),输出自然平庸;但若提供完整职业轨迹、目标公司画像与面试反馈,模型便能生成高度定制化的策略性内容。今天多花30分钟训练AI理解你的工作流,明天可能节省10小时重复劳动。低质量输入 → 平庸输出 → 失望放弃 → 能力停滞。而前1%的用户恰恰打破了这一循环,他们以系统视角看待人机协作,将AI纳入自己的认知基础设施。通过对数十位高绩效AI使用者的深度观察,我们提炼出一套四维认知框架。这套框架并非孤立技巧的堆砌,而是一个协同运作的整体。 维度一:关系定位——从“助理”到“同事”的范式转移 上下文共享:不再假设AI“应该知道”,而是主动提供背景、目标、约束与偏好; 责任共担:允许AI提出质疑、挑战假设,而非仅执行指令;目标对齐:将AI纳入目标设定过程,使其理解“为什么做”而不仅是“做什么”。 Anthropic教育负责人Drew Bent指出:“提示词工程的时代已经结束。未来的关键是社交技能——如何与AI建立信任、传递意图、共同演进。” 数据显示,前1%用户在实际交互前,平均花费80%的时间准备上下文。大模型的本质是概率推理引擎,其价值随输入信息的维度与深度呈非线性增长。当上下文足够丰富,模型不仅能回答问题,还能发现用户未曾察觉的关联与盲点。 普通用户带着预设方案寻求确认:“这个文案怎么样?” 前1%用户则带着开放难题寻求共创:“我在A和B两个方向间犹豫,各自的长期风险是什么?有没有第三条路径?” 现代大模型在模糊、复杂、多约束的问题域中表现最佳——而封闭式问题(如“总结这篇文章”)恰恰是模型最容易“应付”的任务,难以激发其涌现能力。研发时间:用于构建个性化智能体、训练领域知识库、测试新工作流,追求杠杆。 他们通常将10%-20%的工作时间划为“AI研发时间”,专门用于实验与迭代。这种配置看似降低短期效率,却在3-6个月内形成显著复利效应。例如,一位投资人用两周时间训练AI自动解析财报、生成行业对比报告,此后每份报告的处理时间从8小时降至45分钟。 高质量上下文 → 深度协作 → 开放探索 → 杠杆积累 → 更强的智能体能力。低质量输入 → 浅层交互 → 封闭验证 → 效率幻觉 → 能力停滞。三、认知惰性与技能萎缩的双重陷阱

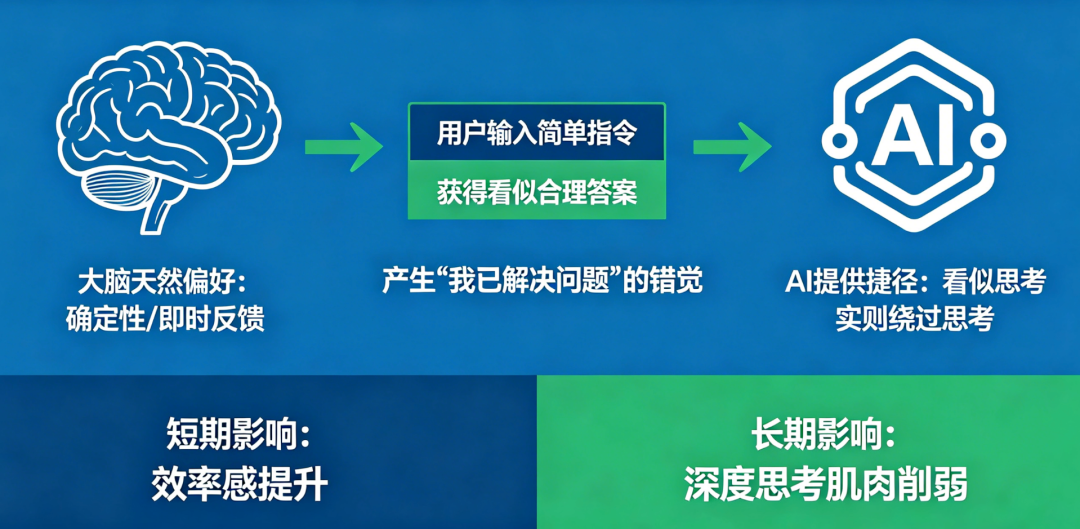

上述鸿沟的背后,隐藏着两个相互强化的机制性病灶。

病灶一:认知惰性的自我强化

人类大脑天然偏好确定性与即时反馈。

AI恰好提供了“看似思考实则绕过思考”的捷径。

用户输入简单指令,获得看似合理的答案,产生“我已解决问题”的错觉。

这种模式短期内提升效率感,长期却削弱深度思考肌肉。

Anthropic内部一项对照实验揭示了这一机制:

两组学生学习编程,一组使用AI辅助,一组纯手工编码。

结果显示,依赖AI组在作业完成速度上快37%,但在脱离AI的概念理解测试中,成绩反而低17%。

然而,那些以探究式态度使用AI的学生(不断追问“为什么这样写?”“有没有其他方法?”),测试成绩与对照组无显著差异。

这说明,问题不在于AI,而在于使用范式。

交易型使用(索取答案)导致技能萎缩,协作型使用(共同探索)则增强认知。

病灶二:能力评估的滞后偏差

用户往往以静态视角评估AI能力。

Drew Bent指出:“你每天上班时,可能还在用一个月前的能力标准审视眼前的AI。但事实是,AI的能力正呈指数级增长。”

这种滞后导致用户持续用旧方法测试新能力,得出“AI不过如此”的错误结论。

例如,2023年用户需精细提示词才能获得结构化输出;

而2024年模型已能自主规划多步任务。

但若用户仍沿用旧提示模板,便无法触发新能力,进而强化原有偏见。

这是一种典型的能力-方法错配。

这两个病灶共同构成认知陷阱:

惰性使人不愿深入,滞后使人无法看见。

唯有同时克服二者,才能跨越鸿沟。

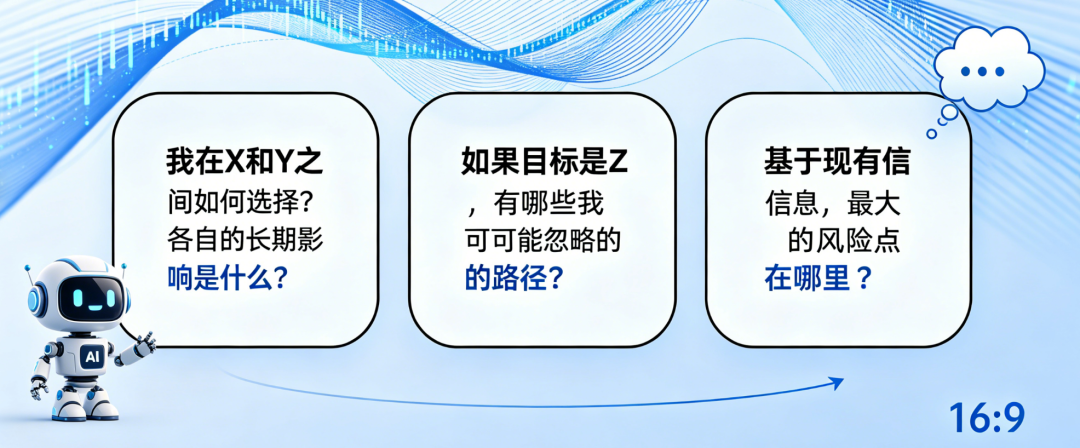

从“与聊天机器人对话”转向“构建AI智能体团队”。AI智能体(Agent)的本质,是具备目标、记忆与行动能力的自主程序。它不再是被动响应的对话界面,而是能主动执行复杂任务链的数字员工。一个市场研究智能体可自动抓取行业新闻、分析竞品动态、生成周报,并根据反馈调整关注重点; 一个投资分析智能体可每日解析财报、监控舆情、标记异常信号,并推送定制化洞察。 那位500美元/月完成5万美元工作的营销负责人,正是通过编排多个智能体实现的。他不再逐条下达指令,而是设定目标(“提升某产品线转化率”),由智能体团队自主规划路径、分配任务、迭代优化。 Drew Bent断言:“构建AI智能体将是未来30年专业人士的基础技能,如同过去40年掌握Excel一样。” 1. 杠杆效应:单个智能体可7×24小时工作,边际成本趋近于零;2. 复利效应:智能体的知识库与策略库随时间积累,能力持续增强。 基于前述分析,我们提炼出一套四步行动框架,帮助读者完成认知跃迁:将这份清单作为每次交互的“启动包”,让AI真正理解你的处境。 “我在X和Y之间如何选择?各自的长期影响是什么?”每月向AI提出一个“当前看似无法解决”的需求,例如:“自动追踪我所在行业的政策变化,并评估对我业务的影响”; 你是探路者,不是跟随者。只有不断挑战边界,才能发现新可能。前1%的人之所以领先,并非因为他们掌握了神秘技巧,而是因为他们率先完成了三个根本转变: Drew Bent在访谈末尾提到:“我们现在大概只发挥了AI应有潜力的1%。” 当AI从对话界面进化为智能体网络,其杠杆效应将呈指数级释放。 对专业投资者、产业研究者与企业管理者而言,这场认知革命尤为关键。在信息过载、竞争加剧的时代,谁能率先构建高效的AI协作者网络,谁就能在复杂系统中保持清晰判断、快速迭代与战略定力。 因为真正的价值,永远属于那些敢于重新定义人机关系的人。

文中观点仅为作者观点,不代表本平台立场

各位读者朋友,公众号改了推送规则,如果您还希望第一时间收到我们推送的文章,请记得给北大纵横公众号设置星标。 点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”

点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”