淘工位首页/行业资讯/AI残酷现实 | 目前占比99%的营销型CEO正在失宠,1%的产品型CEO迎来回归!/ AI残酷现实 | 目前占比99%的营销型CEO正在失宠,1%的产品型CEO迎来回归!

2026-03-10 00:00:00

文章转载自"北大纵横"

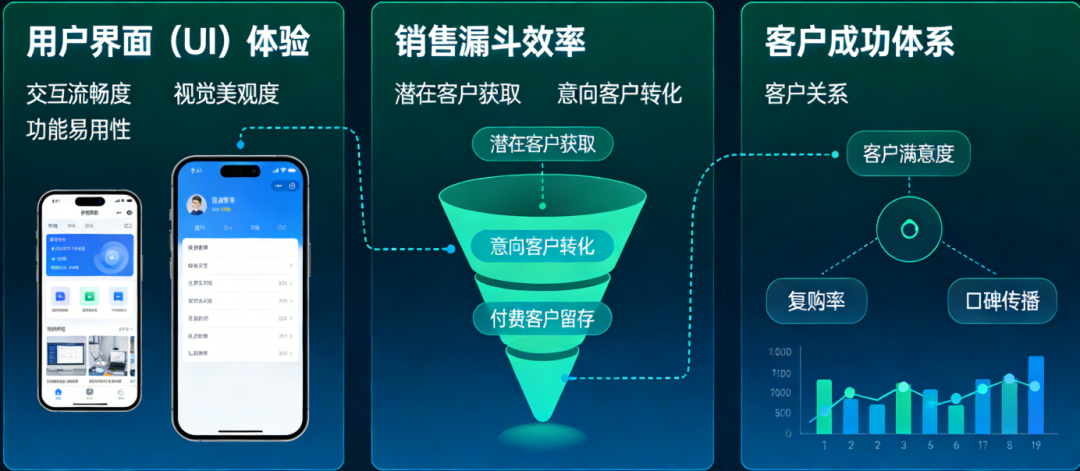

摩根士丹利TMT峰会会场外,太平洋的海风裹挟着冷意,吹散了去年此时还弥漫在科技圈的AI狂热。而今,投资者的问题已从“你用AI了吗?”变为“你能活下来吗?”这场由摩根士丹利全球科技投资银行部主管David Chen主持的闭门会议,汇聚了黄仁勋、Satya Nadella、Sam Altman与Dario Amodei等AI核心人物。这场对话表面是行业顶流的年度聚会,内里却是一场关于企业存续逻辑的残酷解剖。笔者通过深度梳理峰会核心对话与后续产业动向,发现一个清晰的主线正在浮现:在AI范式转移的第二阶段,确定性已成为衡量企业价值的终极标尺。这一判断并非空泛修辞,而是植根于3个相互咬合的结构性变化:软件护城河的重新定义、CEO能力模型的战时切换、以及基础设施层的刚性需求崛起。它们共同构成了一套可验证、可迁移、可行动的认知框架——2024年,SaaS公司普遍以“AI提效”为卖点:这些功能确实降低了运营成本,但其本质仍是边际优化。David Chen在峰会上直言:“效率提升只是入场券。你是AI的受益者,还是AI会威胁到你的整体业务?”用户界面(UI)体验、销售漏斗效率、客户成功体系。但在AI智能体(Agent)崛起后,这些优势正被系统性瓦解。当一个Agent能直接调用API完成酒店预订、发票核验或合同起草时,传统SaaS作为“人机交互中介”的存在理由便不复存在。年初企业软件股的集体抛售,万亿市值蒸发,正是市场对“伪AI受益者”的清算。旧护城河基于增长与体验,新护城河则基于确定性与不可替代性。工资计算错一分钱可能引发劳资纠纷,税务申报偏差一个百分点将触发稽查,医疗账单的小数点错误足以导致法律诉讼。这些不是“事后可修正”的问题,而是信任崩塌的导火索。他在摩根士丹利用Copilot总结会议纪要,即便有2%的误差也无伤大雅;但若用AI生成客户账单,哪怕0.1%的错误都不可接受。这些系统嵌入企业核心流程,数据私有、逻辑严谨、容错极低。传统厂商凭借二十年积累的行业Know-how、客户深度绑定和专有数据,反而构筑了AI难以逾越的壁垒。一旦AI Agent能直接调用API完成任务,其作为“中间层”的价值将迅速蒸发。大量过去依赖“信息差”和“交互体验”取胜的SaaS公司,正站在悬崖边缘。他们的业务模式本质上是“把Excel搬上云端”——“我们过去五年做的,不过是给公开数据包了个漂亮壳子。现在,AI连壳子都不需要了。”David Chen透露,在近期多场董事会讨论中,一个尖锐问题反复出现:“我们的CEO,是销售/营销背景出身,还是真正的产品型领导者?”营销型CEO擅长讲增长故事、优化LTV/CAC、推动渠道扩张——但在AI重构价值链的今天,仅靠营销已无法应对底层技术范式的颠覆。产品型CEO的核心能力,在于对技术演进路径的动态洞察与快速重构能力。他们必须能带领团队彻底重写后端架构,实现“AI原生化”——并非简单接入API,而是将LLM深度融入业务逻辑,构建具备确定性输出能力的新一代系统。Anthropic内部几乎不写PRD(产品需求文档),而是“疯狂做原型”;OpenAI的Co-work模式强调工程师与产品经理的实时协作——在AI时代,产品迭代速度与技术理解深度,远比完美的商业计划书重要。这也解释了为何Sam Altman与Dario Amodei虽风格迥异(前者乐观务实,后者忧患深重),却都被视为“战时CEO”的典范。他们不仅是战略家,更是深度参与技术路线选择的产品架构师。如果说确定性护城河决定了谁不会死,那么SaaaS(Software for Agents as a Service)则指明了谁可能赢。我们已经从SaaS(软件即服务)转向了SaaaS(面向智能体的软件即服务)。人类每天使用几十个应用已是极限,但一个企业可能部署成千上万个Agent,每个Agent都需要专用工具链——分析显示,Agent as a Service市场预计将从2024年的51亿美元增长到2030年的471亿美元,年复合增长率达44.8%。Agent操作系统:管理Agent生命周期、权限、记忆;Agent间通信协议:确保多Agent协作的可靠性;确定性执行环境:在概率性LLM之上构建确定性工作流。谁能率先构建这类“Agent-native”平台,谁就可能成为下一代微软或Salesforce。值得注意的是,这类平台天然具备网络效应与高切换成本——一旦企业将核心流程编排进某个Agent生态,迁移成本将极其高昂。这正是David Chen看好网络安全等垂直领域的原因:它们既是AI的受益者(需保护Agent行为),又具备深厚的行业壁垒与确定性需求。当应用层陷入混战,聪明的资本早已转向“卖铲子”的环节。David Chen指出,过去12个月,内存芯片、光通信、硬盘供应商、半导体设备等细分板块,已成为明星赛道。无论最终胜出的是OpenAI、Anthropic还是其他模型,他们都离不开算力基础设施——而基础设施的需求是刚性的、可预测的。内存墙:大模型推理对HBM(高带宽内存)需求激增,预计到2030年HBM市场规模将超过1000亿美元;光互联:GPU集群内部通信瓶颈推动800G/1.6T光模块渗透率快速提升;存储分层:热数据(模型权重)需高速SSD,冷数据(训练语料)依赖大容量HDD。博通之所以能在AI芯片竞赛中突围,并非因其训练芯片性能超越英伟达,而是其在网络芯片(DPU)和定制ASIC领域的深厚积累。次世代半导体公司正从第一性原理出发,重构计算范式。一些初创企业尝试用光计算、存算一体、Chiplet异构集成等方式突破冯·诺依曼瓶颈。预计到2030年,用于AI优化数据中心的资本支出将超过7万亿美元,这一规模是以往任何计算转型都无法比拟的。面对Anthropic被列入美国政府黑名单、OpenAI内部治理争议等风波,市场难免质疑:这些年亏损数十亿美元的AI Lab,真能上市吗?David Chen的回答斩钉截铁:“考虑到庞大的潜在市场(TAM)、机遇以及他们所创造资产的稀缺价值,我认为绝对可以!”当前,真正具备千亿级token训练能力、百万级GPU集群调度经验、以及顶级安全对齐研究的AI Lab,全球不超过五家。投资者不再纠结于短期毛利率,而是评估其长期垄断租金(monopoly rent)潜力。正如2004年的Google,尽管当时搜索广告模式尚未成熟,但其技术壁垒已足够支撑高估值。数据资产:专有训练语料、人类反馈数据(RLHF);这些无形资产虽难会计量化,却是未来十年AI经济的地基。回望2025年的TMT峰会,表面是AI的盛宴,内里却是一场关于“确定性”的集体追寻。投资者用脚投票,抛弃那些仅靠PPT描绘AI愿景的公司,转而拥抱能提供确定性价值、拥有真实护城河、由产品型CEO掌舵的企业。半导体细分赛道的崛起,SaaaS范式的萌芽,AI Lab IPO的临近——所有线索指向同一个结论:AI革命的第一阶段(狂热与泡沫)正在结束,第二阶段(落地与分化)已然开启。在这场大洗牌中,没有永恒的赢家,只有持续进化的幸存者。向下扎根于基础设施,向上构建确定性应用,向内锻造产品型组织。正如David Chen所言:“AI不会杀死软件,而是重塑它。”

文中观点仅为作者观点,不代表本平台立场

各位读者朋友,公众号改了推送规则,如果您还希望第一时间收到我们推送的文章,请记得给北大纵横公众号设置星标。 点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。

点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。