AI时代最稀缺的资源:判断力、品味与价值观

2026-03-15 00:00:00

文章转载自"北大纵横"

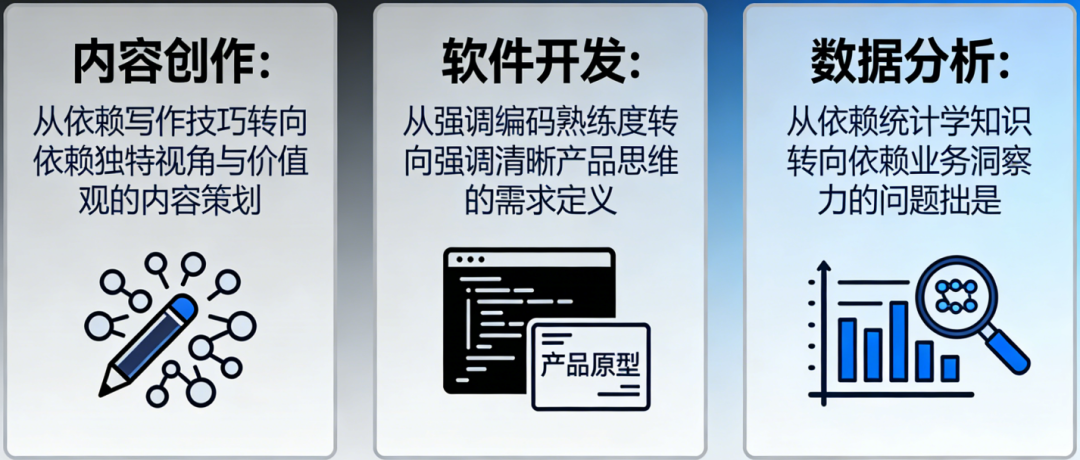

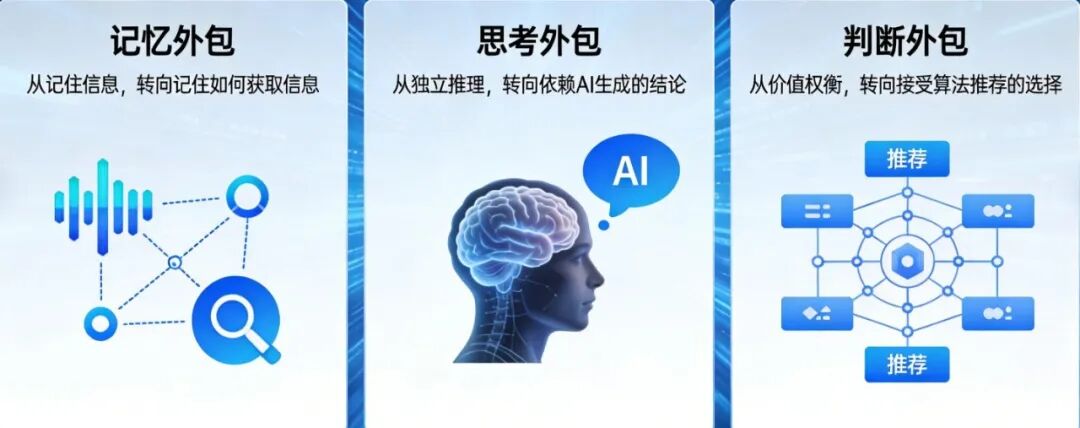

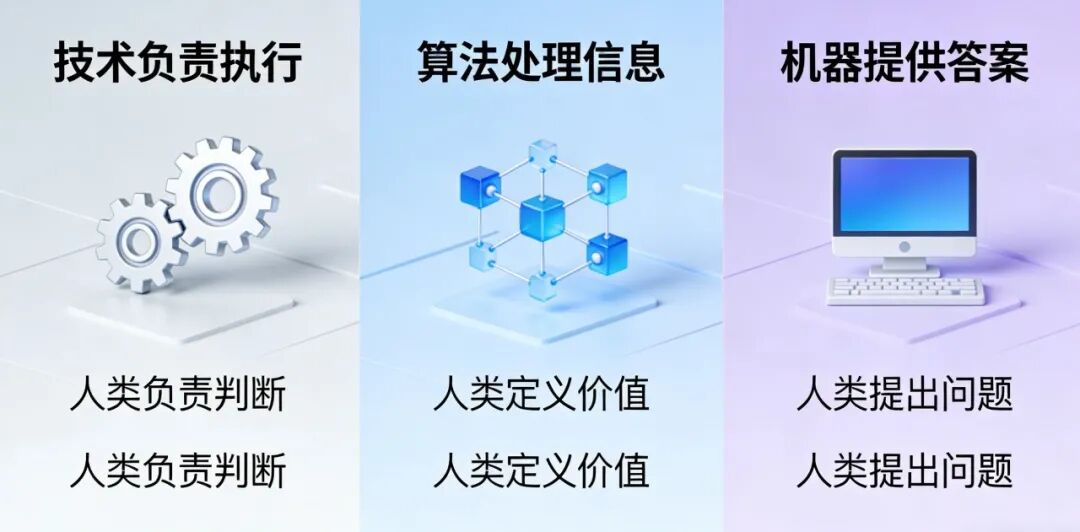

2025年秋,Notion联合创始人Ivan Zhao正与数十个AI智能体协同工作。墙上挂着一张从公司初创时期就陪伴至今的红蓝相间地毯,角落里摆放着一把经典的伊姆斯椅——不是为了炫耀,而是因为"对身体和眼睛都极其舒适"。这种对细节的执着,恰恰揭示了一个正在被忽视的真相:在AI能力爆炸式增长的时代,真正稀缺的不再是技术能力,而是人类独有的判断力、品味和价值观。作为知识工作者,我们正经历一场静默但深刻的范式转移。如今,它已演变为一种基础性"新材料",正在重构整个知识工作的底层逻辑。然而,当执行能力被无限放大,问题定义的质量、价值判断的深度与审美选择的独特性,反而成为决定个体与组织成败的关键变量。AI时代的核心矛盾,已从"能不能做"转向"应不应该做"。将AI视为一种"新材料",这一视角切中了技术革命的本质。青铜终结石器时代,钢铁支撑工业城市,硅芯片催生信息社会。如今,AI成为第四种基础材料——它不只是一种工具,而是一种能够系统性重构知识生产、组织协作与价值创造的基础设施。这种模式类似于18世纪末的工厂主,仅用蒸汽机替代水磨,却未意识到能源丰裕后可彻底重构工厂布局。真正的变革在于,AI能承担组织中高达60%–70%的"信息代谢"工作——包括跨部门同步、会议纪要整理、状态更新与流程协调。这些任务本质上是重复性信息处理,恰是AI的天然优势。以Notion 3.0为例,其AI Agent可一次性连续自主工作约20分钟,处理多达数百页的数据。当AI接管这些协调成本后,人类得以从繁琐的"组织摩擦"中解放,聚焦于更高阶的战略判断与价值创造。但这一转变带来一个关键悖论:技术能力的民主化正在快速消除传统的能力壁垒。三年前,编程是最稀缺的技能之一;今天,任何具备基本逻辑思维的人,借助GitHub Copilot等工具,即可完成复杂编码任务——据GitHub官方数据,开发效率平均提升55%以上。这意味着,未来的瓶颈不再是"能否构建",而是"是否值得构建"。人类能力可解构为三个维度:能力桶(你能做什么)、判断桶(你应该做什么)、能动桶(你愿意做什么)。在前AI时代,能力桶是核心竞争要素——程序员、数据分析师、专业写手因其稀缺技能获得高溢价。但AI正在迅速填平这个桶,不是通过降低标准,而是通过将能力普遍化。内容创作:从依赖写作技巧,转向依赖独特视角与价值观的内容策划;软件开发:从强调编码熟练度,转向强调清晰产品思维的需求定义;数据分析:从依赖统计学知识,转向依赖业务洞察力的问题提出。他们鼓励工程师"尽可能多地消耗Token",将探索置于短期ROI之上。其逻辑在于:在技术快速迭代的环境中,过度优化执行效率会扼杀根本性创新。1920年代的美国曾面临一个关键抉择:城市应以人的尺度还是车的尺度规划?最终,高速公路贯穿城镇中心,汽车成为城市的主人而非工具。今天,我们在AI时代面临类似抉择:是以人的尺度,还是以算法的尺度重构工作?当前的危险趋势在于,许多AI应用无意识地将人类降级为算法的输入源。聊天机器人强化单向交互,个性化推荐制造信息茧房,自动化决策削弱人类参与感。这些并非技术之过,而是设计哲学的偏差——将效率置于体验之上,将自动化等同于智能化。Ivan Zhao提出的"人的尺度"原则提供了一条出路:协作而非替代:AI应增强人类团队的协同能力,而非制造人机对立;透明而非黑箱:决策过程需保持可解释性,确保人类拥有最终控制权;有趣而非机械:工具设计应兼顾美学与使用愉悦感,激发而非抑制创造力。Notion正在构建的AI Agent集合体正是这一理念的体现。他们并非追求单一超级智能,而是设计一个人类团队与AI团队共舞的协作框架——1000名员工与700多个AI Agent并肩作战。这解决了当前AI应用的根本矛盾:个体生产力的提升,常以牺牲团队协同为代价。AI时代最深刻的悖论在于:我们获得了前所未有的答案获取能力,却可能正在丧失提出好问题的能力。学术研究显示,提示工程的动态演进、过程调节的深度赋能及元认知能力的迭代,构成了影响大学生批判性思维能力的关键路径。印刷术普及后,记忆能力确实退化,但认知边界大幅扩展。AI可能带来类似的辩证结果:某些认知能力萎缩,换来整体智力的提升。印刷术用了数百年改变人类认知,而AI可能在五年内完成同等转变。我们没有足够时间反思哪些能力的丧失是值得的,哪些必须保留。正如物理学家费曼所言:"我宁愿有无法回答的问题,也不愿有无法质疑的答案。"在AI时代,这句话有了新含义:当AI能提供看似完美的答案时,保持质疑的能力反而更加珍贵。这要求我们培养一种新的元认知能力——对AI输出的批判性评估、对问题质量的敏感度,以及对价值判断的坚守。传统层级组织本质上是一个信息传递网络:信息从基层收集,经层层过滤,最终抵达决策层。Notion内部的实验提供了一种新范式:700个AI Agent与1000名员工协同工作。AI处理标准化的信息同步与协调任务——新人入职答疑、客户问题匹配、项目进度同步、跨团队协调、文档变更通知。这种模式打破了传统的"规模—效率"权衡——过去,组织扩大必然导致决策迟缓;如今,AI作为"组织钢梁",支撑更大规模的高效运作。但这要求组织文化的根本转型:从控制导向转向信任导向,从流程驱动转向目标驱动。未来的领导者不再是信息的垄断者,而是价值观的守护者。Ivan Zhao曾表示,他想把公司当作一件有商业模式的艺术品来构建。这一愿景在AI时代有了新的诠释——当执行可由AI完成,定义"何为美好"便成为领导者最核心的使命。面对AI带来的"无限心智"可能性,我们需要一套新导航系统。其核心不是算力指标或Token消耗量,而是人文价值。"这是否让人类的工作更有意义?是否增强创造力?是否促进真实连接?"——即坚持"人的尺度"原则。AI时代的变化速度之快,使任何长期规划都极易失效。正确策略是提高实验频率、缩短反馈周期,在行动中学习与校准。最后,也是最关键的:AI不会取代人类,但会重新定义何为"人类价值"。当机器能完美执行任何指令,提出正确指令的能力便成为终极稀缺资源。那张红蓝相间的地毯,那把伊姆斯椅,它们代表的不是怀旧,而是一种坚持——在技术狂飙突进的时代,依然相信美的价值、细节的意义与人类判断的不可替代性。正如巴克敏斯特·富勒所言:"你永远无法通过与现有现实对抗来改变事物。要改变事物,你要建立一个新的模型,让现有的模型过时。"在这个模型中,最稀缺的资源不是算力,不是数据,而是人类的判断力、品味与价值观。

文中观点仅为作者观点,不代表本平台立场

各位读者朋友,公众号改了推送规则,如果您还希望第一时间收到我们推送的文章,请记得给北大纵横公众号设置星标。 点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。

点击左下方公众号“北大纵横”→点击右上角“...”→点选“设为星标⭐️”。